Generative Untertitel: Von Sprache zu Verständnis

03. Sept. 2024

Lesezeit 8 Min.

Lesezeit 8 Min.

Letztes Jahr habe ich einen Blog über die Videolokalisierung geschrieben. Ein Jahr ist eine furchtbar lange Zeit in der Technik – eigentlich ist es für alles eine furchtbar lange Zeit. In den letzten 12 Monaten war Kap Verde das erste Land südlich der Sahara, das seit 50 Jahren von der WHO als malariafrei erklärt wurde. Königin Margrethe von Dänemark dankte ab, so dass es weltweit keine amtierenden weiblichen Herrscherinnen mehr gibt. Japan wurde das fünfte Land, das ein Raumschiff auf dem Mond landete. Und TikTok wurde zur am dritthäufigsten heruntergeladen Social-Media-Plattform der Welt.

Es scheint, dass wir – egal was passiert – kontinuierlich Videos aufzeichnen werden. Laut Statista wird erwartet, dass Medieninhalte im Jahr 2024 Einnahmen in Höhe von 1,6 Billionen US-Dollar generieren und weiter wachsen werden. Verbraucher:innen gewöhnen sich immer mehr daran, Informationen über Kurzvideos abzurufen oder einen beliebigen Film auf Knopfdruck anzusehen. Wir arbeiten ebenfalls rund um die Uhr, indem wir Meetings aufzeichnen (Life-Hack: Ich habe den zeitsparenden Trick entdeckt, Meetings zu überspringen, bei denen ich nichts beitragen kann, und die Aufzeichnungen später mit 1,5-facher Geschwindigkeit anzusehen).

Gleichzeitig entwickelt sich die KI-Technologie sprunghaft weiter. Ich warte immer noch darauf, dass sie meine Hausarbeit erledigt. Wann bekommen wir einen Roomba, der Treppen saugen kann? Aber in der Zwischenzeit können wir weiterhin neue Wege zur Steigerung der Produktivität, der Qualität und zum Einsparen von Kosten entwickeln.

Fachkompetenz gewinnt immer mehr an Wert, während KI zunehmend unsere weniger wichtigen Aufgaben übernimmt. Und wir stellen immer noch fest, dass Videolokalisierung weiterhin ein sehr teurer, spezialisierter Bereich ist. Warum ist das so? Nun, lassen Sie mich hierbei direkt auf den Blog des letzten Jahres Bezug nehmen:

- Es ist eine sehr komplexe Angelegenheit. Es gibt spezielle Anwendungen, mit denen Profis diese Arbeit erledigen können.

- Untertitel sind schwer zu übersetzen. Es gibt Beschränkungen für die Länge des Textes, der Text muss an das Video angepasst werden, Sätze werden aufgrund von Pausen abgeschnitten oder die Szene wechselt … die Liste ist noch länger. Es gibt gute Gründe, warum die Lokalisierung in der Regel von Expert:innen erledigt wird.

- Maschinelle Übersetzung kommt mit Segmentfragmenten nicht gut klar. Untertitel müssen aber zu dem passen, was im Video jeweils zu sehen ist.

- Qualitätssicherung ist zeitaufwendig. Sie müssen sich das gesamte Video in allen Sprachen immer wieder ansehen, anhören und die Untertitel lesen … und noch mal … und noch mal …

- Jede Millisekunde muss stimmen. Denn die Zuschauer:innen merken sofort, ob der Untertitel der tatsächlichen Sprache entspricht.

Wenn die nächste Staffel von Squid Games erscheint, möchte ich, dass diese Untertitel so perfekt wie möglich sind – bitte, Netflix, stellt sicher, dass professionelle Linguist:innen beteiligt sind! Aber bei dem Webinar, das ich verpasst habe, muss ich den Inhalt verstehen, ohne dass es unterbrechende „Rotes Licht, grünes Licht“-Szenen gibt. Aufgrund der kleinen verfügbaren Budgets und der hohen Kosten für die Videolokalisierung werden Webinare in der Regel weder untertitelt noch lokalisiert … Bis jetzt!

Wir stellen vor: Die neue Trados-Funktion „Generative Untertitel“

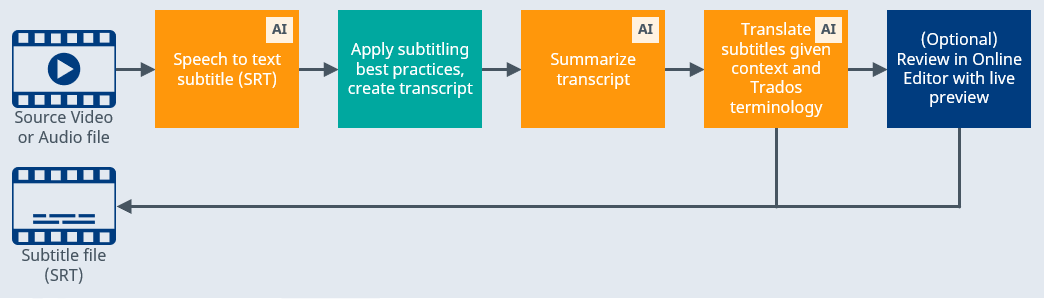

Mit „Generative Untertitel“ können Sie schnell ein Cloud-Übersetzungsprojekt für Ihr Video erstellen (mithilfe des Kundenportals oder eines integrierten Konnektors) und dann zusehen, wie die Untertitel unter Beibehaltung der branchenüblichen Best Practices automatisch generiert werden. Fügen Sie ein benutzerdefiniertes Prompt hinzu, um sicherzustellen, dass Ihr Name korrekt geschrieben wird, wenn Sie vom charmanten Sprecher im Video vorgestellt werden.

Fantastisch, oder? Zur Hälfte ist das Problem gelöst. Aber auch die Lokalisierung ist definitiv eine Herausforderung. Oder besser: Die Lokalisierung WAR auch eine Herausforderung!

Was wäre, wenn wir anstatt der Übersetzung von Segmentabschnitten diese Untertiteldatei jetzt mit einem LLM übersetzen? Und dem LLM eine Zusammenfassung Ihres Videos schicken, damit es Kontext für die Verarbeitung hat? Und gleichzeitig Ihre Terminologie weitergeben?

Sie haben es erraten – Sie erhalten eine hochwertige lokalisierte Version dieser Untertitel! So funktioniert es:

Einen Moment. Der letzte Schritt „Überprüfung im Online Editor mit Live-Vorschau“ … Sie haben es bemerkt, nicht wahr? Sehr clever. Bei Webinaren, Schulungsvideos und vielem mehr ist eine vollständige Automatisierung in der Regel ausreichend. Doch wenn mein Vorgesetzter bei der Aufzeichnung nuschelt, muss ich ihn trotzdem gut aussehen lassen. Sehen wir uns also an, wie das funktioniert.

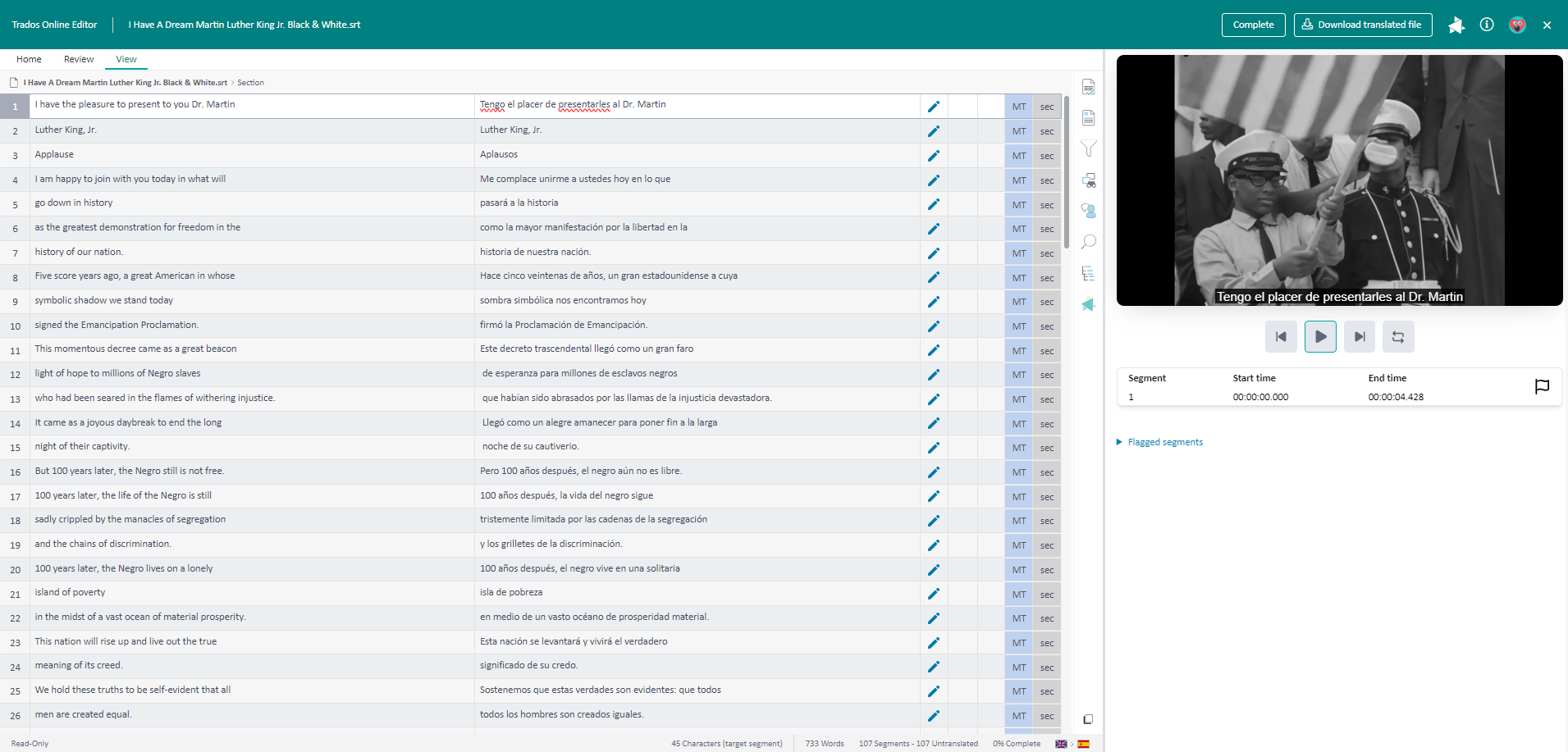

Screenshot der aktiven In-Context-Vorschau im Online Editor

Sehen Sie sich diese Funktion an, während der Text im Online Editor über den Bildschirm läuft und das Video mit Ton wiedergegeben wird. Sie können zusehen, wie sich Ihre Untertitel in Echtzeit ändern, während Sie diesen Text bearbeiten. Markieren Sie Segmente, damit Sie später dorthin zurückkommen und Ihren Vorgesetzten fragen können, was eigentlich sein Gedanke dahinter war. Beziehungsweise – wenn du das liest, Matt (mein Vorgesetzter) – meinte ich eigentlich, damit Sie später wiederkommen und Ihrem Vorgesetzten zu seinen tiefgreifenden Erkenntnissen gratulieren können.

Jetzt denken Sie bestimmt: „Das ist zu gut, um wahr zu sein! Träume ich?“

Wenn Sie das mit meiner Stimme hören und Untertitel unter meinem Kopf auftauchen sehen, ist die Antwort wahrscheinlich – JA! Aber wenn nicht, lassen Sie uns über das Übliche sprechen.

- Datenschutz und -sicherheit? Bingo! Die in dieser fantastischen Lösung verwendeten LLMs werden in der RWS Language Cloud gehostet. Ihre Daten sind nie öffentlich.

- Workflow-Automatisierung? Bingo! Dabei wird Ihre standardmäßige Cloud-Umgebung von Trados mit Projektvorlagen, Workflow-Vorlagen, Aufgabenzuweisungen usw. genutzt. Speisen Sie die Videos ein und gehen Sie einen Kaffee trinken.

- Berichterstellung? Bingo! Es handelt sich um ganz normale Projekte. Wir werden weiterhin zu Nachverfolgungszwecken neue Daten hinzufügen, aber Sie können Ihre rasante Produktivität garantiert unter Beweis stellen.

- Das ist fantastisch! Jetzt fragen Sie sich wahrscheinlich, was kann Trados eigentlich nicht?

Nun, Deadpool und Wolverine werden nicht mit Trados allein untertitelt. Unsere Freunde bei Marvel werden wahrscheinlich eine spezielle Lösung verwenden, wie z. B. CaptionHub, mit der sie Zeitstempel ändern, Untertitel auf dem Bildschirm verschieben und Deadpools expressive Ausdrücke umgangssprachlicher übersetzen können.

Möchten Sie die Ergebnisse sehen? Unsere Elevate-Videos wurden mithilfe dieser Lösung untertitelt und lokalisiert.

Möchten Sie dies in der Praxis erleben? Wenden Sie sich an Ihren Account Manager, um eine Demo zu vereinbaren. Und bringen Sie Popcorn mit, denn Multimedia wird Ihr neuer bevorzugter Dateityp werden.