Generative Subtitles : De la parole à la compréhension

03 sept. 2024

8 minutes de lecture

8 minutes de lecture

L'année dernière, j'ai rédigé un blog sur la localisation vidéo. Une année est une période terriblement longue en matière de technologie. En réalité, c'est une période terriblement longue pour tout. Au cours des 12 derniers mois, l'OMS a révélé que le Cap-Vert était le premier pays d'Afrique subsaharienne à ne pas avoir déclaré de cas de paludisme depuis 50 ans. La reine Margrethe du Danemark a abdiqué, ne laissant plus aucune souveraine en titre dans le monde. Le Japon est devenu le cinquième pays à envoyer une navette spatiale sur la Lune. TikTok est devenu la troisième plateforme de réseaux sociaux la plus téléchargée au monde.

Il semble que, quoi qu'il arrive, nous continuons à enregistrer des vidéos. Selon Statista, les contenus multimédias devraient générer 1,6 billion de dollars de chiffre d'affaires en 2024 et leur augmentation se poursuivra. Les consommateurs sont de plus en plus habitués à recevoir des informations dans des courtes vidéos ou à accéder à n'importe quel film en quelques clics. Nous travaillons également 24 heures sur 24 en enregistrant des réunions (conseil d'un pro du quotidien : j'ai découvert un excellent moyen de gagner du temps : ne pas assister aux réunions où je n'ai rien à apporter, puis regarder les enregistrements une fois et demie plus vite ultérieurement).

Dans le même temps, la technologie d'IA fait des avancées spectaculaires. J'attends toujours qu'elle gère mes tâches ménagères. Quand aurons-nous un Roomba capable de passer l'aspirateur dans les escaliers ? Mais en attendant, nous pouvons continuer à développer des solutions innovantes pour améliorer la productivité et la qualité, et réaliser des économies.

L'expertise humaine devient de plus en plus précieuse alors que l'IA est sur le point de gérer nos tâches plus routinières. Pourtant, la localisation vidéo reste un domaine très coûteux et spécialisé. Pour quelle raison ? Permettez-moi de tricher un peu et de reprendre directement le blog de l'année dernière :

- La tâche est très complexe. Il existe des applications spécialisées conçues pour permettre aux professionnels de faire ce travail.

- Les sous-titres sont difficiles à traduire. La longueur du texte est limitée, le texte doit tenir dans la vidéo, les phrases sont coupées en raison de pauses ou de changements de scène, etc. Ce procédé est généralement géré par des professionnels et ce, pour de bonnes raisons.

- La traduction automatique n'est pas adaptée aux fragments de segments. Or, les sous-titres doivent correspondre à l'image affichée.

- L'assurance qualité prend beaucoup de temps. Vous devez visionner, écouter et lire la vidéo dans son intégralité, encore et encore, dans toutes les langues.

- Chaque milliseconde compte. Les utilisateurs remarqueront si le sous-titre est décalé par rapport à l'audio.

Lorsque la prochaine saison de Squid Games sortira, je veux que ces sous-titres soient aussi parfaits que possible. Netflix, je vous en supplie, faites appel à des linguistes professionnels ! Au contraire, pour ce webinaire que j'ai manqué, je dois simplement comprendre le contenu qui ne comporte aucune scène stressante. Malheureusement, en raison du coût élevé de la localisation vidéo, ces webinaires ne disposent pas de budgets importants et ne sont donc généralement pas sous-titrés ou localisés… enfin jusqu'à présent !

Présentation de la nouvelle fonctionnalité Trados Generative Subtitles

Avec Generative Subtitles, vous pouvez rapidement créer un projet de traduction dans le cloud pour votre vidéo (à l'aide du portail client ou d'un connecteur intégré), puis regarder avec admiration les sous-titres se générer automatiquement, conformément aux meilleures pratiques du secteur. Ajoutez une invite personnalisée afin de veiller à ce que votre nom soit correctement orthographié lorsque ce « maître de cérémonie » à l'accent sexy vous présente dans la vidéo.

Fantastique, n'est-ce pas ? Le problème est à moitié résolu. Mais la localisation est également un véritable défi. Ou bien, dois-je plutôt dire que la localisation ÉTAIT également un défi !

Et si, au lieu de traduire des extraits de segment, nous prenions désormais ce fichier de sous-titres, utilisions un LLM pour le traduire et envoyions à ce LLM un résumé de votre vidéo afin qu'il dispose du contexte avec lequel travailler ? Et pourquoi ne pas lui envoyer votre terminologie en même temps ?

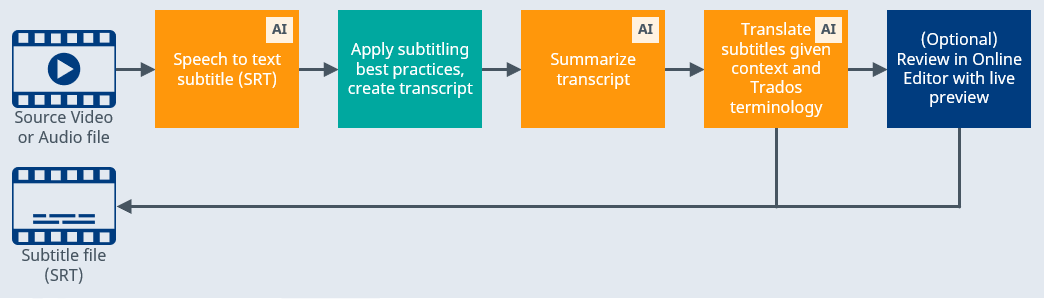

Vous l'avez deviné, la localisation de ces sous-titres sera de qualité ! Découvrez le principe de fonctionnement :

Ce n'est pas fini… Vous avez remarqué cette dernière étape de « révision dans un éditeur en ligne avec aperçu en direct », n'est-ce pas ? Très malin. Bien souvent, pour ces webinaires, vidéos de formation, etc., une automatisation complète suffit. Mais mon patron parlait à voix basse lorsqu'il a enregistré ses instructions, et je dois le présenter sous son meilleur jour. Voyons à quoi cela ressemble.

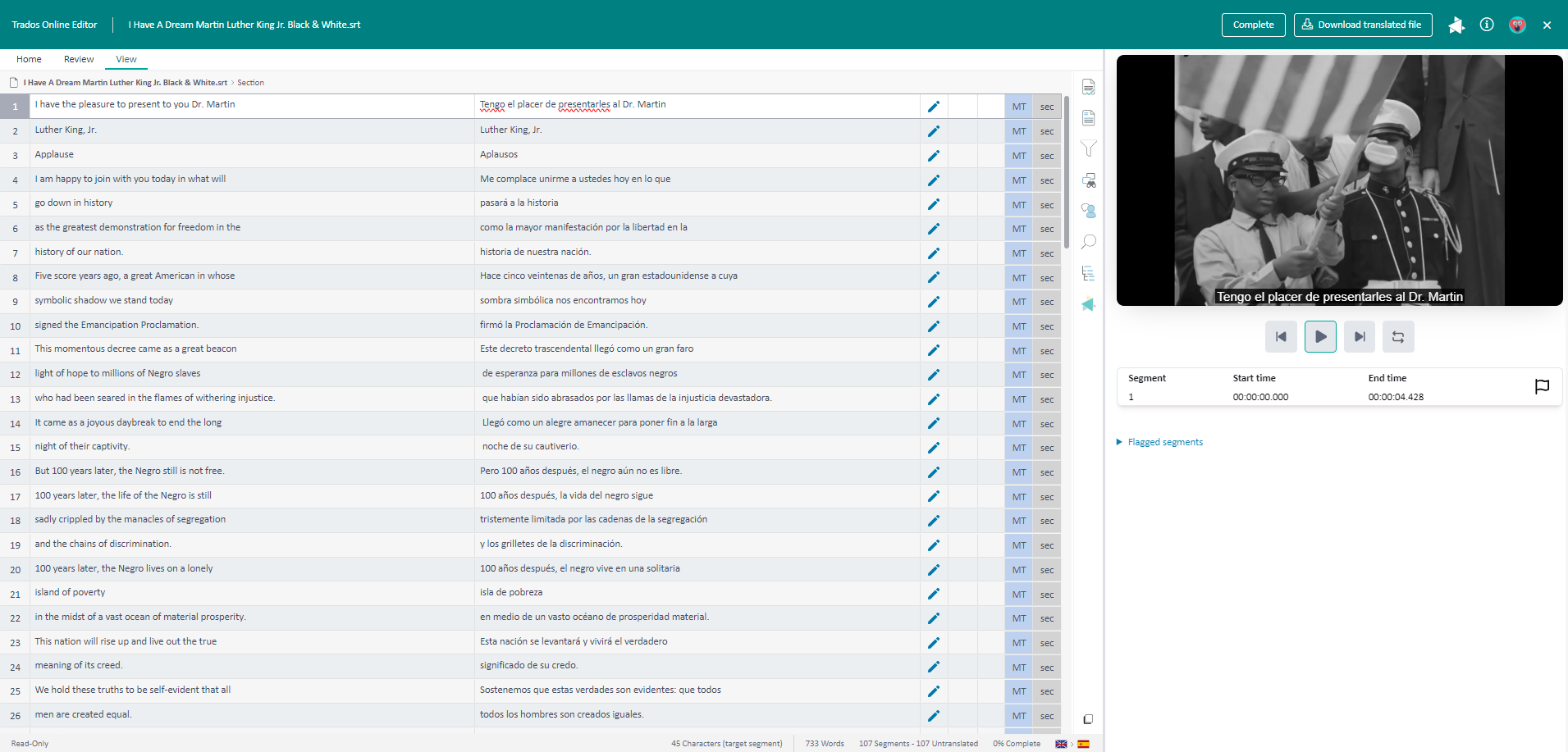

Capture d'écran de la prévisualisation contextuelle en pratique dans l'éditeur en ligne

Découvrez le texte de l'éditeur en ligne défiler comme par magie pendant la lecture de la vidéo, avec le son. Observez vos sous-titres changer en temps réel à mesure que vous modifiez ce texte. Marquez les segments afin de pouvoir revenir ultérieurement et demander à votre patron à quoi il pensait à ce moment précis. Ou plutôt - si vous lisez cela Matt (mon patron) - afin que vous puissiez revenir ultérieurement et féliciter votre patron pour ses connaissances étendues.

Je sais que vous vous dites : Cela semble trop beau pour être vrai ! Suis-je en train de rêver ?

Si vous percevez cela dans ma voix et que vous voyez des sous-titres apparaître dans ma tête, la réponse est… probablement OUI ! Dans le cas contraire, discutons de tout le reste comme d'habitude.

- Sécurité et confidentialité ? Validé ! Les LLM utilisés dans cette solution exceptionnelle sont hébergés dans le système RWS Language Cloud. Vos données ne seront jamais rendues publiques.

- Automatisation de processus ? Validé ! La solution utilise votre environnement cloud Trados standard avec des modèles de projet, des modèles de processus, des affectations de tâches, etc. Ajoutez ces vidéos et allez prendre un café.

- Création de rapports ? Validé ! Ce sont des projets comme les autres. Nous continuerons à ajouter de nouvelles données à des fins de suivi, mais nous vous garantissons que votre productivité grimpera en flèche.

- C'est incroyable ! Vous vous demandez probablement s'il y a des choses que ce cher Trados ne peut pas faire.

Eh bien, Deadpool & Wolverine ne pourra pas être sous-titré uniquement avec Trados. Nos amis de chez Marvel devront probablement utiliser une solution dédiée en parallèle, comme l'une de nos partenaires telles que CaptionHub, qui leur permet de modifier les horodatages, de déplacer les sous-titres à l'écran et de traduire le langage imagé de Deadpool de manière plus informelle.

Vous voulez voir les résultats ? Nos vidéos Elevate ont été sous-titrées et localisées à l'aide de cette solution.

Envie de découvrir tout cela en pratique ? Contactez votre gestionnaire de compte pour planifier une démo… et n'oubliez pas d'apporter du pop-corn, car le multimédia deviendra votre nouveau type de fichier favori.