Proof-of-concept: sottotitoli e didascalie generative

I video e gli altri contenuti multimediali stanno diventando il modo migliore per raggiungere un ampio pubblico. Chi conserva ancora i manuali di istruzioni? Se ho bisogno di cambiare l'aggeggio sul mio trabiccolo, c'è sempre YouTube. Qualcuno non solo mi dirà come farlo, ma me lo mostrerà anche!

Naturalmente, ho il privilegio di essere madrelingua inglese, e più della metà dei contenuti sul Web è in inglese. Il mondo è la mia ostrica!

Ma per chi non parla inglese? Anche i suoi trabiccoli si rompono. Certo, la maggior parte dei browser moderni dispone di funzionalità integrate per visualizzare il testo in altre lingue, ma non i video. Ecco che tornano i manuali di istruzioni!

Perché i creatori di contenuti non localizzano i propri contenuti? Sarebbe sicuramente utile per tutti: per chi cerca di migliorare la propria presenza online e promuovere i propri marchi personali e professionali e per chi consumerebbe molti più contenuti, se questi fossero accessibili. La risposta è semplice… la localizzazione dei video è costosa.

Ma perché è così costosa?

- L'operazione è molto complessa. Così tanto che esistono applicazioni speciali, come quella del nostro partner CaptionHub, progettate per consentire ai professionisti di svolgere questo lavoro.

- I sottotitoli sono difficili da tradurre. Ci sono limiti di lunghezza per il testo, il testo deve adattarsi al video, le frasi vengono tagliate a causa di pause o cambi di scena, e così via. Ci sono buoni motivi per cui questo viene solitamente gestito da professionisti.

- La traduzione automatica non funziona bene con i frammenti di segmento, ma i sottotitoli devono corrispondere a ciò che viene visualizzato sullo schermo in un video, quindi i frammenti sono necessari.

- Il sottotitolaggio da solo non rende il video accessibile ai non udenti. Sono necessarie anche le didascalie, che rappresentano un modo accessibile per gli spettatori che non possono sentire l'audio di seguire il vostro video.

- Il controllo di qualità richiede molto tempo. È necessario guardare, ascoltare e leggere più e più volte, tutto il video in tutte le lingue.

- Anche il millisecondo conta. Gli spettatori si accorgono se i sottotitoli sono sfalsati rispetto al parlato.

L'intelligenza artificiale al momento è su tutte le bocche. Può scrivere le tesi! Può guidare l'auto! Può lavare i piatti: no, aspettate, questo dobbiamo ancora farlo noi. Può almeno rendere i miei video accessibili a chiunque?

La risposta è: SÌ!

Possiamo prendere un video e utilizzare l'intelligenza artificiale per generare i sottotitoli. Sono disponibili dei sistemi LLM (Large Language Model) che riescono a fare un buon lavoro. Attenzione, però: questi modelli sono pubblici e bisogna prestare attenzione ai contenuti inviati. Nel nostro caso di utilizzo? Sarebbe bello se chiunque, ovunque, sapesse come cambiare l'aggeggio sul proprio trabiccolo. Non si tratta di informazioni riservate. Voglio che tutti sappiano chi sono io e come possono farlo.

I sistemi LLM e i sottotitoli sono perfetti? Probabilmente no. Molti sistemi LLM hanno difficoltà con i nomi dei marchi e gli altri nomi propri. È importante? Beh, dipende dalla situazione. Sicuramente non vorrei che i miei curatissimi video di marketing dei prodotti, o dei contenuti che potrebbero essere utilizzati dalle risorse umane o dall'ufficio legale, abbiano dei difetti. Continuerò ad assumere professionisti per questo. Lavorare con il trabiccolo? Il sottotitolaggio automatico potrebbe superare le vostre aspettative.

Eccellente, i sottotitoli sono qui. E ora? Non desidero utilizzare nessuno dei sistemi di traduzione automatica disponibili gratuitamente, perché non solo scombinerà il formato dei sottotitoli, ma non è adatto ai frammenti di segmento. Quella pausa drammatica nel video originale? È gradevole da vedere e da sentire, ma ora ho due pezzi di frase da tradurre invece di una frase completa.

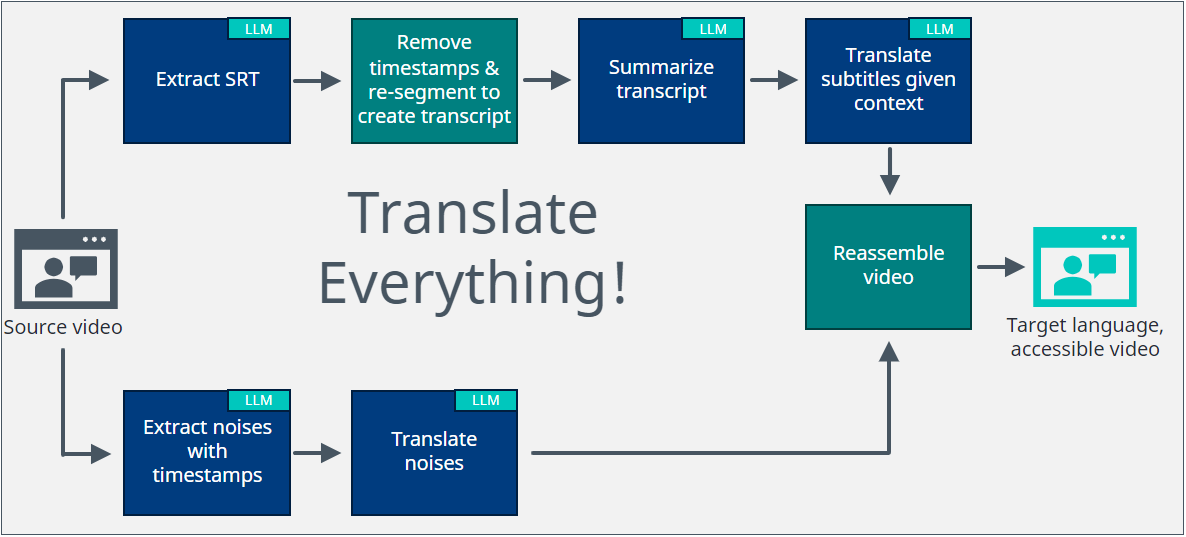

Come può l'intelligenza artificiale migliorare la resa? Innanzitutto, dovete assicurarvi che il vostro sistema LLM sappia di cosa state parlando. Il riso che mangio non è la stessa cosa rispetto al riso che emetto con la bocca. Non potete addestrare la soluzione di traduzione automatica pubblica con informazioni sul contesto, ma potete indicare al vostro sistema LLM di cosa state parlando. Possiamo quindi prendere il file dei sottotitoli e riepilogare il contenuto.

Ma l'intelligenza artificiale prende dei sonori abbagli! Lo sappiamo tutti. Non voglio che il mio aggeggio venga fuori per magia da una trottola. Nessun problema. Prendiamo il riepilogo e indichiamo al sistema LLM di utilizzare il contesto, e solo quel contesto, per tradurre i sottotitoli.

E non dimentichiamo l'accessibilità. Vogliamo che tutti siano in grado di cambiare l'aggeggio sui loro trabiccoli. Quel rumore di scatto quando è serrato correttamente? Assicuratevi che anche le persone con problemi di udito possano utilizzare il video. Il sistema LLM può essere utilizzato per estrarre i rumori con indicazioni di minutaggio precise.

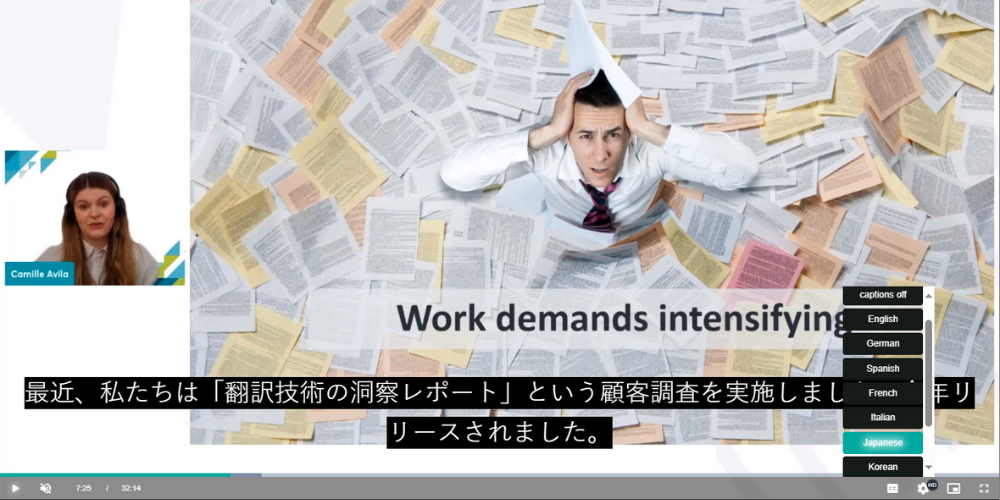

So che può sembrare troppo bello per essere vero, ma potete vedere una dimostrazione del funzionamento di questa tecnologia in uno scenario reale. Vi invito a guardare una delle nostre sessioni registrate dall'edizione di quest'anno di ELEVATE, scegliendo una qualsiasi tra le opzioni linguistiche disponibili nelle didascalie:

I Queen l'hanno detto meglio di tutti: "I want it all, and I want it now!" (Voglio tutto e lo voglio adesso!) C'è un modo per raggiungere questi risultati, in maniera integrata e disponibile senza che i creatori di contenuti debbano fare tutto da soli. Ed è qui che entriamo in gioco noi. Possiamo guidarvi sull'approccio migliore per sfruttare queste nuove incredibili possibilità.

Create... e traducete tutto, perfino i video!